I titolisti non ci lasceranno mai!

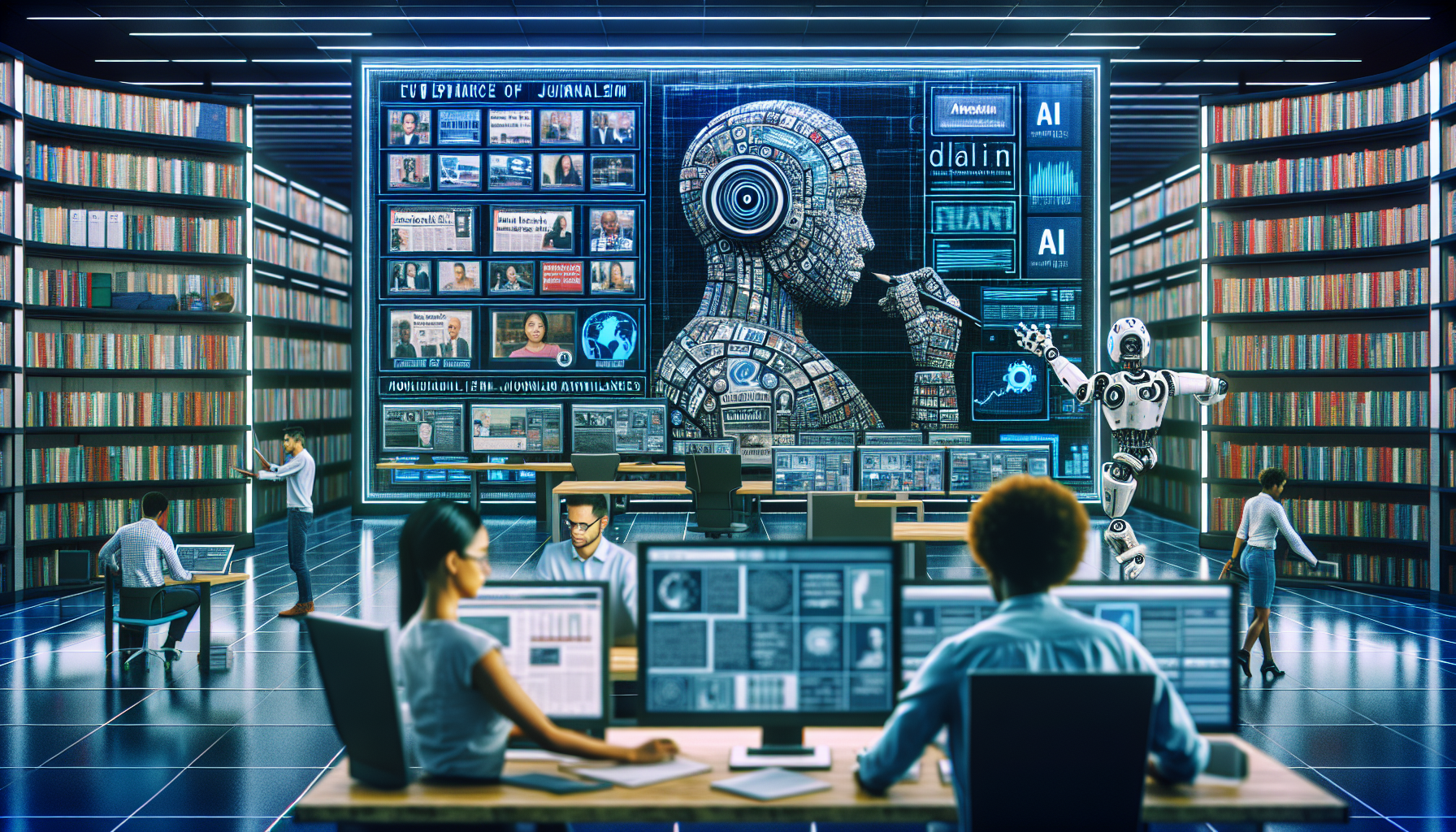

Pubblichiamo l'articolo inedito, vincitore del "Premio Leali Young" al Festival del Giornalismo di Ronchi dei Legionari 2024. In un futuro sempre più dominato dall'intelligenza artificiale chi si occuperà di realizzare i titoli dei giornali?